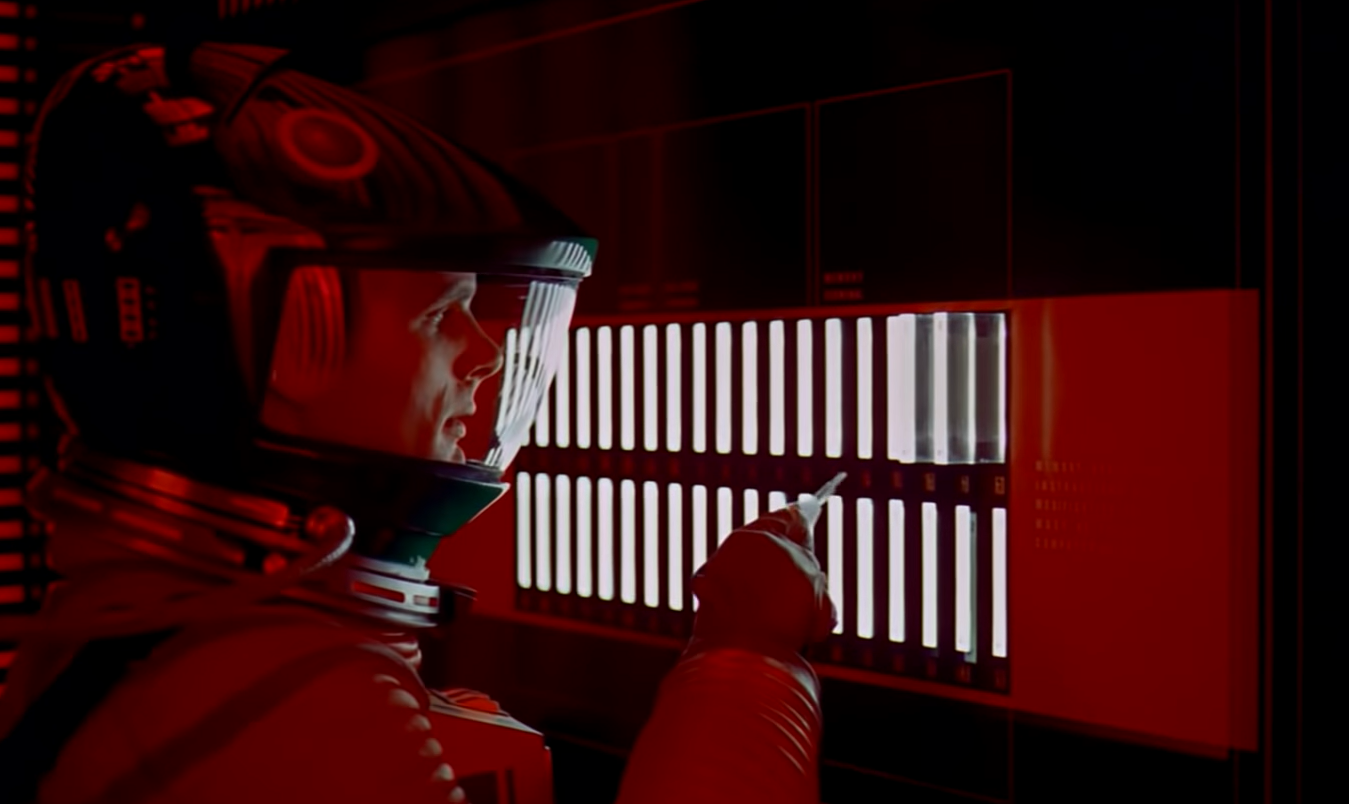

Kultový film, natočený slávnym režisérom Stanleyom Kubrickom na motívy rovnako kultového románu A. C. Clarkea, si za posledné polstoročie pozrelo niekoľko stoviek miliónov ľudí. A súčasťou dojmu, ktorý si z neho odniesli, bolo aj posolstvo, že mysliace počítače môžu byť nebezpečné. Nie nevyhnutne „samy od seba“, ale preto, že si až príliš doslovne vysvetlia svoje úlohy a snažia sa o ich splnenie doslova cez mŕtvoly. HAL povraždil ľudských astronautov na palube Discovery preto, aby neohrozovali plnenie misie, ktorá preňho bola všetkým. Na rozdiel od ľudí ho nezastavili žiadne vrodené zábrany ani empatia, pretože ako stroj nič také nemal.

O niečo divokejším, ale stále ešte dobre zrozumiteľným príkladom, ktorý sa dnes pri debate o umelej inteligencii používa, je hypotetický „sponkový armagedon“. Predstavte si inteligentný počítač – továreň, ktorý dostane za úlohu vyrábať kancelárske sponky. Keďže je to stroj, upne sa na svoju úlohu všetkými silami a venuje sa výrobe sponiek 24 hodín denne, sedem dní v týždni. Ako bude taký stroj reagovať na čokoľvek, čo prekáža alebo aspoň nepomáha jeho hlavnému zadaniu, teda výrobe sponiek? Napríklad na zvyšok ľudskej civilizácie? Nedospeje – podobne ako HAL – k názoru, že takéto prekážky treba odstrániť z cesty ľubovoľnými prostriedkami? Koniec-koncov, je to len stroj a pochopenie toho, že kancelárske sponky majú význam len v širšom kontexte funkčnej a vyspelej ľudskej spoločnosti, mu môže úplne unikať.

Turingov test

Clarkeova kniha napísaná v roku 1968 bola v dobových pomeroch čistá fikcia. Skutočný rok 2001 prišiel a odišiel bez toho, že by vtedajšie počítače dosiahli čo i len inteligenciu makaka alebo vrany. Napriek tomu, že už na prelome storočí bol počítač schopný poraziť najlepších ľudských hráčov v šachu, stále sa s ním ešte nedala udržiavať zmysluplná konverzácia. Zlyhával v jednom základnom teste, ktorému sa podľa jeho autora hovorí Turingov test: ak dokážete v debate vedenej ľubovoľnými prostriedkami odlíšiť človeka od počítača, nemožno počítač nazvať inteligentným.

Budúcnosť na seba nechala nejakú dobu čakať. Sám Alan Turing, ktorý ešte zažil éru technologického optimizmu, by asi nečakal, že prvé systémy, ktoré v ním navrhnutom teste dokážu vierohodne napodobniť človeka, sa objavia až sedemdesiat rokov po jeho smrti. Dnešné ChatGPT, Bing a ďalšie jazykové modely už v Turingovom teste obstoja, aspoň pokiaľ konverzácia nie je príliš dlhá.

Pri masívnom experimente v máji 2023, ktorý vykonala telavivská technologická firma AI21, sa 1,5 milióna dobrovoľníkov snažilo odhaliť, či vedú četovú konverzáciu s robotom alebo so živým človekom. Dokázali identifikovať robota v šesťdesiatich percentách prípadov, čo ešte stále možno označiť ako úspech, ale už to nemá ďaleko od náhodného hodu mincou. Pritom len málokto pochybuje, že ďalšie generácie jazykových modelov na tom budú ešte lepšie ako tie dnešné.

Strach v hrsti kremíka

Keďže veľká časť klasického sci-fi sa venuje vzburám robotov a iných umelých bytostí, reakcia verejnosti na ChatGPT bola očakávateľným spôsobom nervózna až hysterická, rútime sa do nebezpečenstva. Aj na túto reakciu existuje vo svete umelej inteligencie pojem, rovnako veľmi starý (1970): uncanny valley, teda strašidelné údolie. Jeho autor, japonský profesor Masahiro Mori, ním označil očakávanú reakciu ľudí na roboty, ktoré budú príliš podobné živému človeku. Mori je ešte nažive (aj keď sa mu už blíži zaslúžená stovka), na rozdiel od Turinga sa teda naplnenia svojej myšlienky dožil. A jeho „strašidelné údolie“ je pre nás smrteľníkov natoľko desivé, že už vyvoláva reakcie národných parlamentov aj obrích organizácií typu Európskej únie.

Celoplanetárna konverzácia o AI inteligencii a jej budúcej regulácii naráža na nedostatok reálnych skúseností. Fantázie má každý dosť, ale ani veľké mená v tomto odbore sa nevedia zhodnúť na tom, či umelá inteligencia predstavuje skôr umiernené rozšírenie schopnosti súčasného IT sveta alebo potenciálne devastujúci vynález, ohrozujúci samotné prežitie ľudstva. Pokiaľ ide o predstavy o budúcom využití umelej inteligencie, zatiaľ sme zhruba v rovnakej fáze ako naši predkovia pri prílete Halleyho kométy v roku 1910. Vtedy sa v tlači premnožili obrázky z budúcnosti (čím bol myslený rok 1986, ďalší návrat kométy k Slnku), v ktorej sa moderní ľudia vznášajú na nebi v obrích balónoch a vzducholodiach. Nakoniec sa reálny technický vývoj uberal úplne inými cestami a balón zbadáte na dnešnej oblohe maximálne ako atrakciu, zato vtedy nepredstaviteľných prúdových lietadiel nám nad hlavami neustále lietajú tucty.

Škála potenciálneho využitia umelej inteligencie je bezpochyby široká a „táraji“ ako ChatGPT sú nanajvýš špičkou ľadovca. Umelá inteligencia vie analyzovať obrázky a hľadať v nich náročne viditeľné javy, počnúc rastúcimi nádormi a nepriateľským muničným skladom končiac. Vie skladať zložité organické molekuly a odhadovať, či nejaká chemikália môže v ľudskom organizme fungovať ako liečivo. Vie v obrovských súboroch dát identifikovať súvislosti spôsobom, ktorý nám ani nedokáže vysvetliť: napríklad v oftalmológii [očné lekárstvo – pozn. red.] dokáže rozoznať mužské a ženské sietnice (nemáme potuchy ako). Bezpochyby bude vedieť ešte viac, ale zatiaľ si nevieme predstaviť, čo všetko to bude.

1984 ako manuál

V regulácii budúcej umelej inteligencie je zatiaľ najďalej EÚ, pričom na starom kontinente sa jej praktický vývoj príliš neodohráva. Jednu z vecí, ktorým by rada zabránila, je aplikácia umelej inteligencie v policajných a represívnych kontextoch.

Až dosiaľ bola jednou zo slabín totalitných režimov nemožnosť sledovať úplne všetko a úplne všetkých. Len určité percento populácie má bunky, ako aj žalúdok na to slúžiť v tajnej polícii; tak teda aj vo veľmi zošnurovaných štátoch typu niekdajšej NDR existovali určité ostrovčeky súkromia, kam prebujnený štátny aparát nedosiahol. Umelá inteligencia sa dá, samozrejme, vybudovať v ľubovoľnom rozsahu a dnešné počítače sú natoľko výkonné, že na dosiahnutie totálneho sledovania 24/7 netreba extrémne veľký rozpočet. Aj stredne bohatý štát by azda dokázal udržiavať napríklad systém na rozpoznávanie tvárí pokrývajúci väčšinu dôležitých miest.

Snahou oklieštiť použitie biometriky v automatickom sledovaní ľudí sa európske orgány snažia napchať do fľaše džina, ktorý z nej dávno vyletel. Napríklad aj česká polícia tento rok priznala, že už rok „zabeháva“ systém snažiaci sa rozpoznať ľudí v kamerových záznamoch podľa fotografií v štátnej databáze občanov. Pritom na to nedostala žiadne povolenie od parlamentu či vlády a začala ho zavádzať len na základe interného pokynu svojho vlastného riaditeľa. Po odhalení tejto skutočnosti prebehla cez médiá vlna nevôle, ale nezdá sa, že by sa českí poslanci nechali počas svojich prázdnin takými drobnosťami rušiť.

Podobne zaujímavá je otázka, aká silná či slabá bude zamýšľaná regulácia umelej inteligencie v oblasti „sociálneho kreditu“. Zámerom európskych orgánov je zabrániť tomu, aby v EÚ mohli vznikať systémy podobné čínskemu sociálnemu skóre, ktoré sleduje aktivity jednotlivého občana (alebo skôr poddaného?) a vyhodnocuje, nakoľko zodpovedajú ideálu nadiktovanému komunistickou stranou. Veľkí hriešnici môžu v Číne prísť o pôžičky, možnosť cestovať lietadlom či rýchlovlakom alebo im môže byť zakázané nastúpiť do určitých zamestnaní – skrátka, dystopia na steroidoch. Čínsky sociálny kredit bol síce vybudovaný na staršej technológii, ale umelá inteligencia mu nepochybne dokáže dodať väčšiu silu.

Lenže aj keď EÚ nie je pod vládou jednej strany, nedá sa nevšimnúť si, že jej boj proti uhlíkovej stope má mnoho podobných čŕt ako čínske sociálne skóre. Konkrétny súbor sledovaných parametrov sa síce pochopiteľne líši, ale všeobecne je snaha „vychovávať“ európskych občanov k ideálom zoslaným zhora viditeľná takto a patria k nej aj čoraz viac expandujúce mandáty pre korporátne ESG.

Snaha o sledovanie individuálnej uhlíkovej stopy je všadeprítomná, od aplikácie na vyhľadávanie spojenia až po účtovné oddelenia firiem či univerzít. V júni 2023 deklarovala napríklad Univerzita Palackého v Olomouci svoj zámer prihliadať na uhlíkovú stopu pri plánovaní služobných ciest a študentských pobytov. Masarykova univerzita, sídliaca v „pokrokovejšom“ Brne, to, samozrejme, už dávno robí.

Najefektívnejšie by tieto mechanizmy boli vtedy, pokiaľ by sa všetky nazbierané dáta zlievali v jednom obrovskom centre a prideľovali občanom i firmám ich uhlíkové skóre, teda presne to, čo by plánovaná európska regulácia umelej inteligencie mala zakázať. Skutočne sa tomu podarí zabrániť, keď je pre zelené a červené strany naprieč kontinentom klimatická zmena témou číslo jeden?

Riziko tlačiarenského lisu

So zákonnou reguláciou je späté ešte jedno riziko. Dá sa dobre ilustrovať na prípade Osmanskej ríše, ktorá v 16. storočí nedokázala adoptovať novú technológiu – kníhtlač. Nie je jasné, či skutočne išlo o sultánom vydaný zákaz alebo za tým boli nejaké iné dôvody. Prakticky isté však je, že toto zlyhanie viedlo k technickému zaostávaniu celého štátu. Zatiaľ čo európski inžinieri mali k dispozícii čoraz lacnejšie knihy a odborné časopisy, v Turecku bolo šírenie informácií zabrzdené používaním starých metód. Nakoniec na to Osmanská ríša doplatila kolapsom.

Tvrdo zregulovať sotva vznikajúce odvetvie IT a utlmiť lokálne jeho vývoj v sebe prináša to isté riziko: stagnáciu a budúci kolaps alebo ponižujúcu pokoru pred štátmi, ktoré dokázali trend zachytiť a využiť. Riziko vyplývajúce z ničnerobenia nie je také zjavné ako riziko vyplývajúce z činnosti a predovšetkým byrokratická vrstva mnohokrát ani nedokáže pochopiť, v čom údajne vlastne je nejaký problém. Realita však býva k zaostávajúcim hráčom nemilosrdná. Zo slávneho paláca Dolmabahce, z ktorého vládli osmanskí sultáni ríši siahajúcej od Balkánu po Jemen, je dnes múzeum plné turistov.

Text pôvodne vyšiel na portáli Echo24. Vychádza so súhlasom redakcie.